هوش مصنوعی و پایانی بر حقیقت

به گزارش جامجم آنلاین به نقل از دیجیاتو،گزارشی که توسط سایت بازفید منتشر شد نیز نشان می داد که چطور اخبار کذب نظیر تایید شدن دونالد ترامپ از سوی پاپ فرانسیس، بیشتر از خبرهای منتشر شده از سوی منابع معتبر توجه کاربران را به خود جلب نموده است.

اما اندکی بعد از مطرح شدن این اتهامات، مارک زاکربرگ به آنها واکنش نشان داد و ادعای نقش داشتن فیسبوک در نتایج انتخابات ریاست جمهوری آمریکا را رد کرد. اما با توجه به این نکته که تقریبا نیمی از آمریکایی ها خبرهای مهم روز را از طریق این پلتفرم دنبال می کنند، احتمال آنکه فیسبوک نتایج انتخابات را تحت تاثیر قرار داده چندان هم دور از ذهن نخواهد بود.

در هر صورت جنجال خبرهای کذب بسیاری از کارشناسان را بر آن داشت تا به بررسی دقیق تر موضوع بپردازند و در ادامه ایده های جالبی نیز برای مقابله با این مساله مطرح گردید. برای نمونه هم فیسبوک و هم گوگل نمایش تبلیغات از وبسایت های منشا خبرهای کذب را متوقف کردند.

فیسبوک اما پای را از این هم فراتر نهاد و تدابیر تازه ای را برای محدود نمودن خبرهای کذب روی پلتفرم خود اتخاذ کرد؛ برای نمونه امکانی را در اختیار کاربران خود قرار داد تا محتوای مشکوک را گزارش دهند که در این صورت برچسب هشداری تحت عنوان «بحث برانگیز» در کنار آن محتوا نمایش داده می شد.

البته این گام ها همگی امیدوارکننده هستند، با این همه این بیم می رود که برای مقابله با خبرهای کذب کافی نباشند. در واقع تحلیلگران باور دارند که این مساله عمیق تر از چیزی است که به نظر می آید و حتی پیش بینی کرده اند که شکوفایی هوش مصنوعی آن را وخیم تر کند.

آغاز عصر هوش مصنوعی

2016 را همچنین می توان سال شکوفایی هوش مصنوعی دانست. بعد از دورانی طولانی از یاس و ناامیدی، به واسطه پیشرفت های عظیم صورت گرفته در حوزه یادگیری عمیق، حالا زمان بازگشت هوش مصنوعی فرا رسیده است.

اکنون دیگر به جای کدنویسی برای حل مسائل، می توان به کامپیوترها یاد داد که چطور خودشان مشکلات را حل کنند و برایشان راهکار بیابند. این رویکرد انقلابی زمینه را برای ارائه محصولاتی نظیر دستیارهای صوتی از جمله اکوی آمازون و ماشین های خودران مهیا کرده که تا همین چند سال پیش حتی تصورشان غیر ممکن بود.

با این همه، در کنار تمامی این موارد امیدبخش، هوش مصنوعی ایجاد ابزارهایی اثرگذار و در عین حال ترسناک را میسر ساخته که دست بردن در رسانه ها را ممکن می کنند. این ابزارها توان آن رادارند که نحوه دریافت و استفاده بشر از اطلاعات را برای همیشه دستخوش تغییر کنند.

برای نمونه چند هفته پیش بود که ادوبی VoCo را معرفی کرد؛ فوتوشاپی برای محتوای کلامی. اگر بخواهیم ساده تر توضیح دهیم، VoCo نوعی ابزار مبتنی بر هوش مصنوعی است که می تواند صدای انسان را تقلید کند.

تمام آنچه برای کار با این برنامه باید انجام دهید این است که فایل 20 دقیقه ای ضبط شده از صدای فرد مورد نظرتان را در اختیار آن قرار دهید تا در مرحله بعد هوش مصنوعی برنامه آن را تحلیل کند و نحوه صحبت کردن فرد را فرا بگیرد.

سپس هرآنچه می خواهید را تایپ کنید و کامپیوتر آن را با صدای فرد مورد نظر برایتان می خواند. البته ادوبی VoCo را در اصل برای کمک به تنظیم کنندگان و تدوینگران صدا ارائه کرده است تا با کمترین دردسر خطاهای صوتی در پادکست ها و فیلم ها را ویرایش نمایند.

با این حال، همانطور که حدس می زنید، خبر معرفی این برنامه، نگرانی های گسترده ای را در مورد پیامدهای احتمالی کاربرد تکنولوژی مذکور به دنبال داشت که از کاهش اعتماد به روزنامه نگاران گرفته تا ترس از تهدیدات امنیتی را شامل می شود.

البته این پایان ماجرا نیست و آنچه می توانیم با محتوای صوتی انجام دهید با محتوای ویدیویی نیز قابل انجام است.

Face2Face نوعی ابزار مبتنی بر هوش مصنوعی است که می تواند فرایند اجرای ویدیو را به صورت در لحظه انجام دهد. عملکرد برنامه نیز تقریبا مشابه به VoCo است؛ کافیست محتوای ویدیویی ضبط شده از صحبت کردن شخص موردنظرتان را در اختیار نرم افزار قرار دهید تا ریزترین حرکات چهره شخص در زمان صحبت کردن را فرا بگیرد. سپس با استفاده از تکنولوژی دنبال کننده چهره می توانید نقشه صورت خود را روی صورت آن قرار داده و حرکات چهره وی را شبیه سازی کنید.

حال اگر دو تکنولوژی VoCo و Face2Face را با هم ادغام نمایید به ابزاری بسیار قدرتمند دسترسی پیدا خواهید کرد: امکان دستکاری فایل های ویدیویی برای وادار کردن فرد مدنظرتان به گفتن آنچه شما می خواهید آن هم به شیوه ای که تشخیصش از واقعیت تقریبا غیرممکن باشد.

هوش مصنوعی توانمندی های گسترده ای برای قرار دادن خود به جای انسان دارد

البته همه چیز به این نقطه ختم نمی شود و هوش مصنوعی توانمندی های بیشتری برای قرار دادن خود به جای شما دارد. برای نمومه، محققان به تازگی نوعی ابزار مبتنی بر هوش مصنوعی ایجاد کرده اند که می تواند هر دست خطی را تقلید کند و در نتیجه امکان دستکاری اسناد حقوقی و تاریخی یا حتی سندسازی برای دادگاه را در اختیار افراد مختلف قرار دهد.

ترسناک تر از این، نوعی چت بات بهره مند از هوش مصنوعی است که به تازگی توسط استارتاپی نه چندان شناخته شده ارائه گردیده است. این چت بات می تواند با استفاده از سوابق چت شما هرچیزی را در موردتان یاد بگیرد و سپس امکانی را در اختیار دوستانتان قرار دهد که بعد از مرگتان با شمای دیجیتالی صحبت کنند.

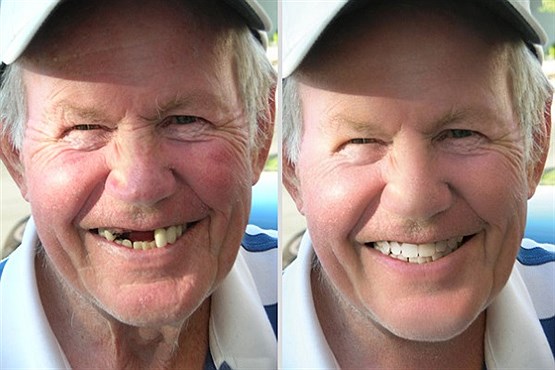

فتوشاپی برای همه

آخرین باری که فریب خورده اید را به یاد دارید؟ زمانی که عکسی را دیدید و تصور کردید که واقعی است اما کمی بعد متوجه شدید با فتوشاپ ساخته شده؟ اگر چنین است باید به اطلاع تان برسانیم که باز هم این اتفاق برایتان رخ خواهد داد.

در دوران نه چندان دور، این جمله را زیاد می شنیدیم که دوربین نمی تواند دروغ بگوید. به لطف اختراع این ابزار برای نخستین بار امکانی فراهم شد که از واقعیت، به همان شکلی که هست تصویر تهیه کرد. در نتیجه طولی نکشید که عکس ها به قابل اعتمادترین شواهد بشر بدل شدند.

در این برهه بود که عباراتی نظیر «خاطره تصویری» ساخته شدند و بارها و بارها مورد استفاده قرار گرفتند. البته که مردم در گذشته نیز عکسها را ویرایش و دستکاری می کردند اما انجام این کار نیازمند داشتن تخصص های ویژه ای بود. حالا اما دیگر اینطور نیست و چنین کاری از عهده هر کسی بر می آید.

نسل امروز خوب می داند که دوربین می تواند دروغگو هم باشد. با گسترش روز افزون ابزارهای ویرایش عکس نظیر فتوشاپ، حالا دیگر دستکاری و اشتراک گذاری عکس به یکی از اصلی ترین سرگرمی های اینترنتی بدل شده. در واقع با ساده تر شدن بیش از پیش فرایند دستکاری عکس ها، تشخیص عکس های واقعی از انواع ساختگی شان بسیار دشوار شده است.

امروزه وقتی تصویری را می بینیم که به نظر غیرواقعی می آید، این تصور در ذهنمان شکل می گیرد که با فتوشاپ دستکاری شده، هرچند که ممکن است اندکی بعد بر ما روشن شود که تصویر واقعی است.

به لطف هوش مصنوعی نیز قدم به سمت آینده ای گذاشته ایم که در آن چنین احتمالی در مورد هر رسانه ای وجود خواهد داشت: متن، صدا، ویدیو و غیره. در نظر داشته باشید، ابزارهایی نظیر VoCo و Face2Face به کلی هم انقلابی نیستند. حتما تایید می کنید که سالهاست فرایند جایگذاری صدا و چهره در هالیوود انجام می گیرد اما مساله اینجاست که برای انجام این کار دیگر نه به افراد حرفه ای نیاز است و نه کامپیوترهای بسیار قدرتمند.

در واقع به لطف این ابزارهای جدید، هرکسی قادر خواهد بود که صرفا با استفاده از کامپیوتر خانگی اش به نتیجه ای یکسان دست پیدا کند.

البته دو ابزاری که به آنها اشاره کردیم شاید در برهه کنونی بهترین نتیجه ممکن را ارائه نمی دهند اما تکنولوژی به خدمت گرفته شده در آنها قطعا به مرور زمان بهبود پیدا می کند و بالاخره به صورت تجاری در می آید.

این فرایند شاید یک سال یا حتی ده سال به طول بیانجامد اما دور نیست روزی که هر نوجوانی به نرم افزارهای مبتنی بر هوش مصنوعی دسترسی پیدا کرده و بتواند با استفاده از آنها رسانه های صوتی و تصویری را به گونه ای که تشخیصش از واقعیت ممکن نباشد تغییر دهد.

با در نظر داشتن اقبال خوب خبرهای کذب در فضای آنلاین و با توجه به این نکته که هم اکنون اعتماد بشر به صنعت رسانه کمتر از هر زمان دیگری است، چنین آینده ای می تواند بسیار دردسرآفرین باشد. برای درک بهتر این مساله کافیست به اثرات احتمالی این فناوری در حوزه های زیر توجه کنید.

قضایی: در این صورت شمار زیادی از اطلاعاتی که هم اکنون در دادگاه ها تحت عنوان شواهد و مدارک مورد استناد قرار می گیرند دیگر معتبر نخواهند بود و دور نیست روزی که دادگاه ها شواهد نوشتاری، صوتی و ویدیویی را نیز به خاطر اینکه راهی برای تشخیص واقعی بودنشان وجود ندارد درست مانند عکس های دیجیتالی نامعتبر قلمداد کنند.

سیاسی: احتمالا شاهد انتشار ویدیوهای شوک آوری خواهیم بود که برای تخریب و تحقیر رقبای سیاسی تهیه می شوند. حتی در مواردی هم که آن ویدیوها واقعی باشند، شخصی که ویدیو به وی مربوط می گردد، می تواند مدعی شود که ویدیو ساختگی است و یا محتوای پخش شده با استفاده از نرم افزارهایی نظیر VoCo ساخته شده.

دنیای پس از حقیقت

در سال 2016 میلادی، گروه دیکشنری های آکسفورد عبارت Post-truth یا پس از حقیقت را به عنوان واژه سال برگزید که با در نظر داشتن رویدادهای اخیر کاملا عقلانی به نظر می رسد و متاسفانه باید بگوییم که تکنولوژی نقشی در تغییر این شرایط ناخوشایند نداشته است.

به بیان دیگر، تکنولوژی همزمان با بهبود زندگی بشر، مرزهای میان حقیقت و دروغ را نیز کم رنگ و کمرنگ تر کرده است. امروزه ما در دنیای فتوشاپ، CGI (تصاویر ساخته شده با رایانه) و اپلیکیشن هایی زندگی می کنیم که با بهره گیری از هوش مصنوعی سلفی هایمان را زیباتر می کنند.

اینترنت با هدف فراهم نمود دسترسی همگان به اطلاعات، وعده مردمی سازی دانش را به ما داد. اما در راستای عملیاتی سازی این وعده، حجم بالایی از اطلاعات به راه افتاد که از انواع و اقسام شایعه گرفته تا اطلاعات نادرست و حتی دروغ را در بر می گرفت.

از آنطرف رسانه های اجتماعی وعده دادند که فضای بازتری را در اختیار کاربرانشان قرار می دهند و آنها را به افراد دیگر در سرتاسر دنیا متصل می نمایند اما این اتفاق نیافتد و در عوض درون اتاقک هایی از بازتاب دیجیتالی محصور شدیم؛ جایی که دروغ های مبهوت کننده، آزاردهنده و تحقیرآمیز به شکلی نظام مند در آن تقویت می شوند و در مقابل برای سازندگانشان درآمدزایی می کنند.

حالا در انبوه تکنولوژی های موجود، هوش مصنوعی قرار دارد که وعده اش متحول نمودن نحوه ایجاد و ویرایش رسانه هاست اما ضمن عمل به این تعهد، تحریف و تقلب را نیز برای دست اندرکاران امر ساده کرده است.

البته این به معنای بد بودن تکنولوژی های مورد اشاره نیست. تکنولوژی در اصل ابزاری برای حل مشکلات است و حل مشکلات هم همواره مساله ای پسندیده و مطلوب محسوب می شده.

درست مانند هرآنچه که می تواند به بهبود این جهان منتهی شود، نوآوری های تکنولوژیکی نیز اثرات جانبی ناخواسته ای دارند که البته در دراز مدت، مزایای آن از معایبش بیشتر خواهد بود.

به لطف همین تکنولوژی کیفیت جهانی زندگی بیشتر از هر زمان دیگری و از هر نظر بهبود یافته: آموزش، امید به زندگی، درآمد و صلح حالا از هر زمان دیگری در تاریخ، در موقعیت بهتری قرار دارند و تکنولوژی علیرغم تمامی ناکامی هایش نقش پررنگتری را در تمامی موارد یاد شده ایفا می کند.

از همین رو شاید بهتر باشد که تلاش های بیشتری برای تجاری سازی ابزارهایی مانند VoCo و Face2Face صورت بگیرد. تکنولوژی همچنان به حیات خود ادامه می دهد و ما نیز نمی توانیم مانع از دستیابی افراد شرور به آن شویم.

بنابراین فراهم نمودن دسترسی به این ابزارها در کنار کلیه پیامدهایی که می تواند داشته باشد، افراد را از وجود آنها و البته ماهیت قابل تخریب رسانه ها مطلع می کند.

درست مانند فتوشاپ و عکاسی دیجیتالی، بالاخره روزی می رسد که بشر خود را با دنیایی وفق می دهد که در آن، محتوای نوشتاری، صوتی و ویدیویی به سادگی از سوی هر فردی قابل دستکاری خواهد بود و کلیه ابزارهای مورد استفاده برای تولید این نوع محتوا دیگر جنبه سرگرمی خود را از دست خواهند داد.

تازه ها

گوناگون

نگاهی به ضرورت بازنمایی رشادتهای عملیات بیتالمقدس در قالب ادبیات مدرن

فتح خرمشهر در آینه کتاب

گفت و گوی اختصاصی جام جم آنلاین با حسن روشن

نمایش شجاعانه در جام جهانی برایمان کافی است

ناصر ابراهیمی در گفت وگو با جام جم آنلاین ؛

قلعه نویی دل شیر دارد / بازیکنان خودشان را باور داشته باشند صعود میکنیم