سوی تاریک هوش مصنوعی

برخی از فناوریها بعدها برای اهداف مجرمانه استفاده شدهاند. دیپفیک نمونهای از چنین فناوریهایی محسوب میشود.

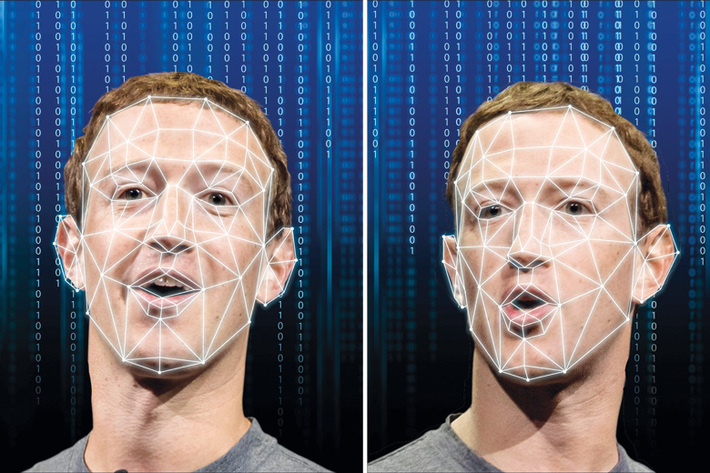

برنامههای مبتنی بر هوش مصنوعی چهره فردی را با چهره دیگری در یک فیلم یا عکس جایگزین میکند. قربانی دیپفیکها اغلب افراد مشهور، سلبریتیها و سیاستمداران هستند.

دیپ فیک ترکیبی از دو کلمه «Deep» و «Fake» است. دیپ به فناوری هوش مصنوعی که با نام یادگیری عمیق شناخته میشود اشاره دارد.

فناوری دیپفیک در رسانههای مصنوعی برای تولید محتوای جعلی و جایگزین یا ترکیبکردن چهرهها و گفتار و دستکاری احساسات استفاده میشود.

به عبارت دیگر، دیپفیک میتواند انجام کاری را توسط شخصی بهصورت دیجیتالی شبیهسازی کند و این در حالی است که آن شخص آن کار را انجام نداده است. موضوع دیپفیک سروصدای بسیاری در فضای مجازی بهپا کرده است.

کاربردهای دیپفیک: گسترش دیپفیک با فیلمهای مستهجن شروع شد و بسیاری از سلبریتیهای زن قربانی شدند. گروه بعدی که قربانی دیپفیک شدند، سیاستمداران بودند. برای مثال، در ویدئویی اوباما به ترامپ توهین میکرد و در ویدئوی دیگری، ترامپ بلژیک را برای ملحق شدن به توافقنامه اقلیمی پاریس مسخره میکرد. شما میتوانید برنامههای بسیاری در اپاستور و گوگلپلی برای جایگزینکردن چهره در عکسها و فیلمها پیدا کنید. برخی عقیده دارند دیپفیک آینده تولید محتوا است. جالب است بدانید چندی پیش شبکه MBN کرهجنوبی از دیپفیک استفاده کرد تا گوینده اخبار خود را جایگزین کند.

رواج باجگیری: دیپفیک در دستان افرادی که قصد باجگیری یا بدنام کردن دیگران را دارند، ابزار بسیار مخوفی محسوب میشود. متأسفانه جامعه ما بهویژه نسل قدیمی از وجود فناوری دیپفیک آگاه نیست. رافائلا اسپون از پنسیلوانیا فیلمهای دیپفیکی از اعضای یک گروه تشویقکننده که برهنه در حال سیگار کشیدن بودند منتشر کرد تا رقبای دخترش را حذف کند. خوشبختانه، خانواده قربانیان با پلیس تماس گرفتند و نقشه او برملا شد.

سیاست: همانطور که پیشتر اشاره شد، سیاستمداران اغلب قربانی ویدئوهای دیپفیک میشوند. این ویدئوها میتوانند آسیبهای جدی به آرای کاندیداها در انتخابات وارد کنند. در سال 2019، فرانچسکا پانتا و هالسی بورگوند از دانشگاه فناوری ماساچوست ویدئوی دیپفیکی با حضور رئیسجمهور آمریکا ریچارد نیکسون ساختند.

در این ویدئو، نیکسون شکست برنامه آپولو 11 را اعلام کرد و گفت هیچکدام از سرنشینان از ماه برنگشتند. آنها ششماه روی این ویدئو با متخصصان دیگری کار کردند. هدف آنها این بود که ویدئویی شبیه ویدئوی واقعی ساخته شود تا پتانسیل فناوری دیپفیک نشان داده شود.

هنر: یکی دیگر از کاربردهای محبوب دیپفیک در هنر است تا پرترههای معروف صحبت کنند. محققان روسی چنین کاری را با مونالیزای داوینچی کردند. موزه دالی در فلوریدا، سالوادور دالی را از فیلمهای آرشیوی برای جذب بازدیدکنندگان بازسازی کرد.

فیلم: در فیلمها اغلب تغییر آرایش یا چهره بازیگران ضروری است. در فیلم «Rogue One: A Star Wars Story»، دیپفیک استفاده شد تا چهره پرنسس لیا و گرند موف تارکین بازسازی شود. استودیوی تحقیقات دیسنی در حال ساخت فناوری جلوههای بصری دیپفیک خود است که میتواند زمان و هزینهها را بهصورت قابلتوجهی کاهش دهد.

شبکههای اجتماعی: درحالیکه برخی از شبکههای اجتماعی مانند فیسبوک و توییتر با دیپفیک میجنگند و رسانههای جعلی را مسدود میکنند، سایر شبکههای اجتماعی از این فناوری استقبال میکنند. ویژگی دوربین تغییر چهره از سال 2016 در اسنپچت در دسترس است. همچنین تیکتاک با استفاده از تکنیکی اجازه میدهد کاربرانش چهره خود را در ویدئوها تغییر دهند.

هویت جعلی آنلاین: اولیور تیلور، دانشجویی در دانشگاه بیرمنگام بود. عکسهای شبکههای اجتماعی او نشان میداد در یک خانواده یهودی بزرگ شده و در فعالیتهای ضدیهودی شرکت میکند. او بعدها زوجی را متهم به همدردی با تروریستها کرد. در آن زمان مشخص نشد چه کسی این صفحه را مدیریت میکند. در سال 2017، گروهی از محققان نرمافزار Synthesia را کشف کردند. این نرمافزار مبتنی بر هوش مصنوعی بود که میتوانست محتوای سمعی و بصری برای رسانههای جعلی بسازد. نرمافزار به کاربران اجازه میداد ویدئوهایی با شخصیتهای تخیلی بسازند.

آینده دیپ فیک

به نظر میرسد رقابت بین تولید، تشخیص و جلوگیری از دیپفیک در آینده شدید و شدیدتر شود؛ زیرا روزبهروز دسترسی به فناوری دیپفیک و تولید آن آسانتر از گذشته شده و تشخیص ویدئوهای دیپفیک از ویدئوهای واقعی سختتر میشود.

ما درحالحاضر نیز الگوریتمهایی را در اطراف خود میبینیم که میتوانند بسیار واقعی بهنظر برسند و تقریبا در همان لحظه ساخته شوند. محققان بر این باروند که در آینده تشخیص ویدئوهای ساختهشده با فناوری دیپفیک تقریبا غیرممکن خواهد شد.

درحالیکه استفاده از دیپفیک برای اهداف مثبت در بخشهای سرگرمی، اخبار و آموزش بهسرعت در حال افزایش است، دیپفیک تهدید جدیتری را ازجمله افزایش فعالیتهای مجرمانه، گسترش شایعات، کلاهبرداری با هویت ساختگی و دخالت در انتخابات به مردم معرفی میکند.

برای مثال، شما خواهید توانست کاری را که شخصی هرگز انجام نداده است با استفاده از تصویر او شبیهسازی کنید و به احتمال زیاد نیازی به کسب اجازه از آن فرد نخواهید داشت. زمانی که ویدئو در فضای مجازی منتشر شود، دیگر هیچ کنترلی بر نحوه استفاده و تفسیر از آن نخواهید داشت.

برای حداقلسازی فریب و تضعیف اعتماد، محققان، خبرگزاران و قانونگذاران نقشی حیاتی در آموزش مردم درباره قابلیتها و خطرات رسانههای مصنوعی ایفا خواهند کرد.

اگر بتوانند به مردم یاد دهند تنها به محتواهای منابع معتبر اعتماد کنند، استفادههای مثبت از دیپفیک میتواند بیشتر از استفادههای منفی از آن باشد.

با افزایش آگاهی مردم، میتوان تاثیرات منفی فناوری دیپفیک را محدود کرد، روشهایی برای همزیستی با آنها و حتی برای کسب منفعت از آنها در آینده پیدا کرد.

دیپفیک فناوری بسیار جوان و امیدبخش است و بشریت هنوز در حال آشنایی با آن است. ما به زمان نیاز داریم تا تمام کاربردهای آن را درون جامعه خود و صنایع مختلف پیدا کنیم و نهایت استفاده را ببریم. همانند فناوریهای دیگر، این فناوری نیز دارای مزایا و معایبی است.

دیپ فیک میتواند به دنیای ما آسیب برساند یا آن را بهبود بخشد. با گذشت زمان، خواهیم توانست روشهایی برای کنترل آن همانند فناوریهای دیگر پیدا کنیم.

عباس ملک حسینی - ایدهپرداز در زمینه تجارت الکترونیک / ضمیمه کلیک روزنامه جام جم

ناصر ابراهیمی در گفت وگو با جام جم آنلاین ؛

قلعه نویی دل شیر دارد / بازیکنان خودشان را باور داشته باشند صعود میکنیم